Die ganze KI-Sache hat uns mit dem Release von ChatGPT ganz schön überfahren. Und obwohl seitdem eine Menge passiert ist, denke ich es ist gerade ein guter Zeitpunkt zum Durchatmen und den Versuch einzuordnen, wo wir gerade stehen. Ein ruhiger Moment. Vielleicht ist es der letzte ;)

Wo stehen wir mit der AI Race?

Dieser Blogpost als Song

Keine Lust meinen Blogpost zu lesen? Hier gibt es den Beitrag in Liedform.

Lyrics ChatGPT, Song & Voice: Suno Music AI

Mein Beitrag: Ich habe den ersten Grobentwurf dieses Artikels in ChatGPT kopiert und darum gebeten, es als Liedtext neu zu schreiben. Dann habe ich den Liedtext in Suno kopiert und das Genre vorgegeben. #mindblown

Ein Moment relativer Ruhe

Was meine ich damit, dass dies ein relativ ruhiger Moment ist? Es passieren doch dauernd neue Dinge! Erst vor wenigen Wochen hat uns Sora gezeigt, was im Bereich Video geht. Und seit April 2024 kann dank Suno und Udio wirklich jeder von uns ziemlich beeindruckende Musikstücke generieren lassen.

Der Grund, aus dem ich denke, wir sind in einer Phase der Ruhe, ist dieser: Alle großen Releases der letzten Monate scheinen mir Anwendungsfälle zu sein, die zwar unglaublich beeindruckend sind und zeigen, was mit Machine Learning alles möglich ist, aber sie repräsentieren keinen neuen Durchbruch auf der Suche nach künstlicher Intelligenz.

ChatGPT war ein symbolischer Moment, der eindrucksvoll bewies, dass AI weiter ist, als wir gedacht haben, und in der Folge eine Menge an Geld und Hirnpower anzog. All das Geld ist jetzt auf der Suche nach Anwendungsfällen und wer einen guten Pitch hat, hat gute Chancen, Investoren zu finden. Wenn wir jedoch auf die aktuellen Frontline-Modelle schauen, habe ich den folgenden Eindruck: Der letzte große Durchbruch war GPT-4.0 im März 2023. Seitdem haben andere Modelle gleichgezogen oder auch in bestimmten Aspekten ein bisschen überholt. Einerseits kommen regelmäßig neue Features und Use Cases dazu, die teilweise sehr beeindruckend sind, z. B. immer größer werdende Kontextfenster, immer bessere Videogenerierung etc., aber: Wenn wir den CEOs der wichtigsten Player wie OpenAI, Anthropic, Google und Meta zuhören, reden sie von ganz anderen Dingen. Hier wird von einer Zukunft gesprochen, in der AI Großteile der heutigen ökonomisch wertvollen Arbeit selbstständig übernehmen kann. Von Superintelligenzen und agentischer AI, die praktisch alles besser kann als wir. Von "fully automated luxury communism".

Und was diese ganz großen Entwicklungssprünge angeht, haben wir in den letzten Monaten nicht viel Neues gesehen.

Relativer Stillstand am Beispiel Gemini

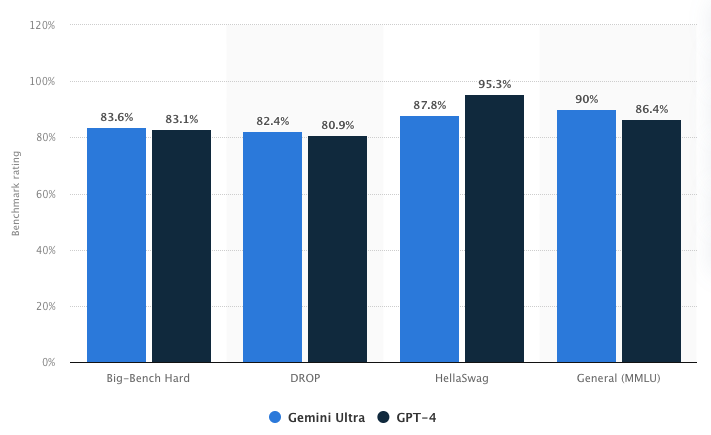

Hier sehen wir Gemini vs. GPT-4 in einer ganzen Reihe an Benchmarks, die zur Bewertung von LLMs eingesetzt werden.

Quelle: https://www.statista.com/statistics/1450833/benchmark-comparison-gemini-ultragpt- 4/

Was das Bild zeigt, ist ein Unentschieden. Ein paar Prozentpunkte hier und ein paar Prozentpunkte dort, das wars. Und es sei einmal dahingestellt, wie genau die verschiedenen Benchmarks überhaupt testen. Der MMLU war lange einer der Goldstandards zum Testen von LLMs über viele verschiedene Gebiete hinweg, hat aber auch einige Probleme, die es schwer machen zu sagen, ob der Unterschied zwischen 86 und 90 Prozent überhaupt etwas Bedeutungsvolles misst – so enthält der MMLU beispielsweise fehlerhafte Antwortschlüssel. Noch dazu unterscheiden sich die Prompttechniken, die bei den Tests angewendet wurden (Quelle: https://blog.google/intl/de-de/unternehmen/technologie/gemini/); Gemini verwendete eine Chain of Thought-Technik (CoT@32), GPT-4 wurde mit 5-Shot-Learning getestet. Wie man es auch dreht und wendet, für mich sieht das Ergebnis nach Unentschieden aus. Fazit: AI ist zwar revolutionär, aber in den letzten 12 Monaten gab es keine neue AIRevolution.

Prognose: Ende 2025 wissen wir mehr!

Das kann viele Gründe haben. Beispielsweise wurden alle aktuellen Frontline Modelle wie GPT, Claude, Llama und Gemini auf ähnlicher Hardware trainiert. Es gibt einen Rückstau zwischen dem, was gerade im Hardwarebereich passiert (dedizierte AI-Chips etc.) und dem Training von Modellen, die diese neue Hardware nutzen.

In den nächsten Wochen und Monaten werden Modelle veröffentlicht werden, die auf neuer Hardware und neuen Techniken beruhen. Und dann wird es spannend. Lässt sich mit mehr Scale noch mehr erreichen? Wann stoßen wir da an Begrenzungen (z. B. Compute oder Energiebedarf)? Oder ist da vielleicht auch viel Hype dabei und und wir nähern uns bald asymptotisch an ein Maximum dessen an, was auf Machine Learning basierende AI erreichen kann? Meine eigene Haltung: Bis Ende 2025 werden wir mehr wissen. Wenn bis dahin nichts grundlegend Neues passiert ist, scheint es so, als würde so schnell vielleicht kein Step Change in der zugrundeliegenden Technologie mehr kommen. Ich rechne zwar damit, dass etwas Großes kommt, aber Ende 2025 ist mein Reality Check. Entweder leben wir dann in einer anderen Welt oder AI ist vielleicht einfach überhypt.

Disclaimer

Ich bin kein KI Experte. Es ist möglich, dass ich die aktuellen Fortschritte einfach falsch einschätze. Vielleicht braucht es gar keinen radikalen Schritt mehr, keine plötzliche Explosion der Frontline-Modelle. Vielleicht kommen wir auch mit kontinuierlicher Weiterentwicklung im Stil der letzten 12 Monate schon sehr bald in einer Welt an, die sich radikal von der heutigen Unterscheidet. Oder vielleicht ist mein Zeitrahmen von "Ende 2025" auch zu kurz gedacht. Vielleicht braucht es ja bis 2027, um irgendein spezifisches, kompliziertes technisches Problem zu lösen. Only time will tell. Geht davon aus, dass ihr mir in diesem Post beim Denken zuseht, nicht, dass ihr alle Antworten erhaltet.

Things to watch: Agentische KI und mehr

Zum Abschluss: Falls bis Ende 2025 die große Revolution kommt, was ist es, das wir sehen würden? Auf was könnte man achten? Da fallen mir vor allen zwei Dinge ein:

Erstens: General Reasoning

Im Moment sind die sprachlichen Fähigkeiten der Modelle zwar beeindruckend, nach dem ersten WOW, bemerkt man jedoch schnell, dass der Output etwas Formelhaftes hat. Auch in Bereichen wie Mathematik und Logik ist der ganz große Wurf noch nicht gelungen. Zum Beispiel hat meines Wissens nach noch kein LLM einen neuen Zweig der Mathematik erfunden. Wenn wir Nachrichten hören, dass sich hier etwas fundamental verschiebt, dann sollten wir hinhören!

Zweitens: Agentic AI

Aktuell geben wir den KI-Modellen einen Input, z. B. einen Prompt, dann verarbeiten sie diesen und geben uns eine Antwort. Wir wechseln uns ab und die AI reagiert auf das, was wir tun, ohne dabei allzu aktiv in der Welt zu werden. Agentic AI wäre anders. Wir würden Disclaimer Ich bin kein KI Experte. Es ist möglich, dass ich die aktuellen Fortschritte einfach falsch einschätze. Vielleicht braucht es gar keinen radikalen Schritt mehr, keine plötzliche Explosion der Frontline-Modelle. Vielleicht kommen wir auch mit kontinuierlicher Weiterentwicklung im Stil der letzten 12 Monate schon sehr bald in einer Welt an, die sich radikal von der heutigen Unterscheidet. Oder vielleicht ist mein Zeitrahmen von "Ende 2025" auch zu kurz gedacht. Vielleicht braucht es ja bis 2027, um irgendein spezifisches, kompliziertes technisches Problem zu lösen. Only time will tell. Geht davon aus, dass ihr mir in diesem Post beim Denken zuseht, nicht, dass ihr alle Antworten erhaltet. so etwas sagen wie: "Organisiere den Geburtstag meiner Tochter!" und die KI würde sich selbst einen Plan machen, um diesen in die Tat umsetzen. Sagen wir: In den Zirkus gehen. Andere Eltern müssten kontaktiert werden, andere Kinder eingeladen. Es gilt Tickets zu organisieren und die Anfahrt zu planen. All das wird vorbereitet, vielleicht mir zur Genehmigung vorgelegt und dann durchgeführt, ohne dass ich etwas machen muss. Das ist grundsätzlich anders als die Art und Weise, wie wir heute mit AI interagieren. Wenn sich hier tatsächlich etwas tut, das wäre der Next Step! Zu diesem Punkt gibt es übrigens eine Menge interessanter Gedanken in diesem Podcast.